Gedanken des Autors

"Das Thema LLM-Vergleich hat in den letzten Jahren einen großen Diskussionsraum eröffnet, und jeder LLM-Anbieter versucht, seine Lösung als die expliziteste, genaueste und vielseitigste darzustellen.

Silk Data als Unternehmen mit umfassender Expertise in KI-Lösungen und LLM-Integrationen hat den kritischen Ansatz stets geschätzt. Daher stellt der folgende Blogbeitrag kein LLM-Ranking dar, sondern unsere Sicht auf die Fähigkeiten der beliebtesten LLMs."

Yuri Svirid, PhD. — CEO Silk Data

LLM-Branchenüberblick

Am 30. November 2022 veröffentlichte Open AI sein Produkt ChatGPT – einen Chatbot mit einer generativen KI-Funktion, die menschenähnliche Antworten in natürlicher Sprache auf Nutzeranfragen liefert.

ChatGPT zog sofort ein großes Publikum an und bot eine breite Palette von Fähigkeiten, wie Programmieren, Übersetzen sowie Textanalyse und -zusammenfassung auf Basis tiefer kontextueller und semantischer Analyse.

Beispielsweise zeigt einer der neuesten Berichte der News Bureau und des Digital Future Center der Elon University, dass mehr als die Hälfte der US-Erwachsenen ChatGPT-ähnliche LLMs täglich aus verschiedenen persönlichen Gründen nutzt.

Darüber hinaus war der Beginn des Jahres 2025 von der Veröffentlichung von DeepSeek V3 geprägt – einem LLM-Chatbot, der als ‚ChatGPT-Killer‘ gedacht war. Obwohl beide Tools weiterhin existieren und florieren, löste DeepSeek eine große Diskussion darüber aus, welches Modell besser ist. Die Diskussion geht noch weiter, da Google und Anthropic neue Versionen ihrer eigenen LLMs veröffentlichten – Gemini 2.5 bzw. Claude 3.7.

Der folgende Blogbeitrag wird einen umfassenden Überblick über große Sprachmodelle geben und die bekanntesten Vertreter vergleichen.

Was ist ein LLM und wie funktioniert es?

LLM oder Large Language Model (großes Sprachmodell) ist ein KI-Programm, das auf Machine-Learning-Prinzipien basiert und hauptsächlich darauf ausgelegt ist, menschliche Sprache zu erkennen, zu verarbeiten und zu generieren.

Das Wesen der LLM-Funktionsweise liegt in seiner Machine-Learning-Basis.

Traditionell impliziert die LLM-Entwicklung, ein Programm mit großen Datenmengen zu füttern. Diese Daten können sich auf spezifische Aufgaben beziehen (Marketing-Berichte, wissenschaftliche Artikel für die Textzusammenfassung usw.) oder alles, was menschliche Aktivität betrifft (Grundlagen der menschlichen Sprache, Struktur und Hierarchie eines wissenschaftlichen Fachgebiets usw.).

Hinweis! Die derzeit beliebtesten LLM-Modelle wie ChatGPT gelten als Foundation Models (Grundlagenmodelle), d.h. Modelle, die mit so großen Datenmengen trainiert wurden, dass sie über eine breite Palette von Anwendungsfällen eingesetzt werden können. Wir entdecken das Wesen und die Vorteile von Foundation LLMs gründlich in unserem Blogbeitrag zu ChatGPT.

Neben Machine Learning stützen sich moderne LLMs auf zwei weitere grundlegende Prinzipien.

Deep Learning beschreibt das Prinzip, bei dem Modelle Muster und Fakten aus den geladenen Daten mit minimaler menschlicher Einmischung lernen können.

Gleichzeitig nutzt eine spezielle Art von neuronalem Netzwerk, genannt Transformer-Modell, die Self-Attention-Technik, um die Sequenz und Muster zwischen Datenelementen zu identifizieren.

Alle oben genannten Techniken und Prinzipien ermöglichen es großen Sprachmodellen, tabellarische und Textdaten wahrzunehmen, zu verarbeiten und den Kontext zu identifizieren. Zusammen bilden sie eine Grundlage für die Generierung menschlicher Sprache und umfassende Antworten auf Nutzerfragen, die moderne LLMs liefern können.

LLM-Geschichtsüberblick

Bevor wir LLMs vergleichen, sollten wir einen kurzen Blick darauf werfen, wie sich die Technologie entwickelt hat. Historisch lässt sich die Evolution von LLMs in drei Hauptphasen unterteilen:

- 1

Frühe Natural Language Processing Modelle

Die Hauptvertreter sind N-Gramme, wobei 'n' für die Anzahl der Wörter steht, die das System gleichzeitig oder in einem bestimmten Zeitintervall wahrnehmen kann. Solche Systeme hatten äußerst begrenzte Fähigkeiten im Hinblick auf das Verständnis komplexer sprachlicher Strukturen sowie von Mustern und Beziehungen zwischen Textteilen. - 2

Rekurrente neuronale Netze (RNNs)

Ein Prinzip, das Anfang der 2010er Jahre aufkam, wurde zuvor im Abschnitt über die Entwicklung von Chatbots mit Natural Language Processing beschrieben. Es basiert auf der Verarbeitung tokenisierter Sequenzen und der Ausgabe der Ergebnisse dieser Verarbeitung. Modelle, die auf diesem Prinzip basieren, verbesserten die Leistung und erweiterten die Fähigkeiten großer Sprachmodelle, aber sie waren immer noch schwer zu skalieren und auf komplexe Aufgaben anzuwenden, die ein breites Kontextverständnis erforderten. - 3

Modelle basierend auf der Transformer-Architektur

Diese Modelle basieren auf einer Technologie, die einen Mechanismus verwendet, der einem Sprachmodell ermöglicht, die Bedeutung und den Platz jedes Wortes im Kontext des gesamten Textes zu identifizieren und zu erkennen (seine Beziehung und Hierarchie zu anderen Wörtern und seinen Einfluss auf sie im Kontext der gesamten Sequenz), unabhängig von seiner Position in diesem Text. Die Transformer-Architektur ist eine Basis, auf der alle beliebtesten modernen LLM-Systeme arbeiten, einschließlich GPT (Generative Pre-trained Transformers). - 4

Große multimodale Modelle und Foundation Models

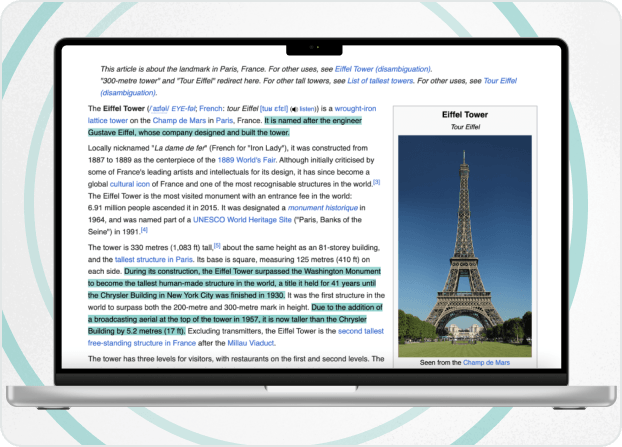

Die letzte bekannte Stufe der LLM-Evolution, die Anfang der 2020er Jahre auf die Bühne gebracht wurde. LMMs und Foundation Models sind die prominentesten Vertreter der LLM-Branche, die beispiellose Fähigkeiten im Umgang mit verschiedenen Inhaltstypen erlangen (zum Beispiel die Transformation von Text-Prompts in Bilder).Gleichzeitig können die meisten der neueren großen Sprachmodelle über eine breite Palette von Aufgaben und Themenfeldern hinweg eingesetzt werden, aufgrund der großen Größe der Datensätze, mit denen sie trainiert wurden. Darüber hinaus gibt es jetzt immer mehr Fälle, in denen die LLM-Entwicklung auf dem RAG-Ansatz basiert. Dies wird durch die Praxis definiert, bei der der RAG-Mechanismus das Internet oder externe Quellen durchsucht, um mehr Kontext in die Antwort auf eine Nutzeranfrage einzubringen.

Darüber hinaus können einige spezialisierte Foundation Models das herausragendste Kontextgedächtnis bieten, und in einigen Fällen kann die Größe des Kontextfensters im Vergleich zu traditionellen LLMs um ein Zehnfaches größer sein.

Ein Überblick über alle oben genannten Daten bietet ein besseres Verständnis dafür, wie moderne große Sprachmodelle zu ihrem aktuellen Zustand gekommen sind. Ein Vergleich von LLMs erfordert jedoch auch eine detaillierte Untersuchung der prominentesten Branchenvertreter.

ChatGPT 4.5

Am 27. Februar 2025 veröffentlichte Open AI eine neue GPT-4.5-Version seines Modells.

Der umfassende Blogbeitrag der Entwickler selbst erwähnt die folgenden Verbesserungen:

Verbesserte Fähigkeit, Muster zu erkennen, Verbindungen zu finden und Inhalte zu generieren.

Eine natürlichere Art der Interaktion.

Fortgeschrittene Fähigkeiten in Problemlösung, Schreiben und Programmierverbesserungen.

Erhöhte Modellsicherheit dank einer größeren Anzahl von Stresstests und Sicherheitstests.

GPT-4.5 verwendet eine skalierte Kombination aus zwei Entwicklungs-Paradigmen: Unsupervised Learning (unüberwachtes Lernen) und Reasoning (logisches Schlussfolgern).

Das erste Paradigma konzentriert sich auf Verbesserungen in Bezug auf Muster- und Kontexterkennung und die Fähigkeit des Modells, diese vorherzusagen.

Das Skalierungsparadigma konzentriert sich auf die Bewältigung logischer Aufgaben oder Aufgaben, die aus einer langen Abfolge von Schritten bestehen.

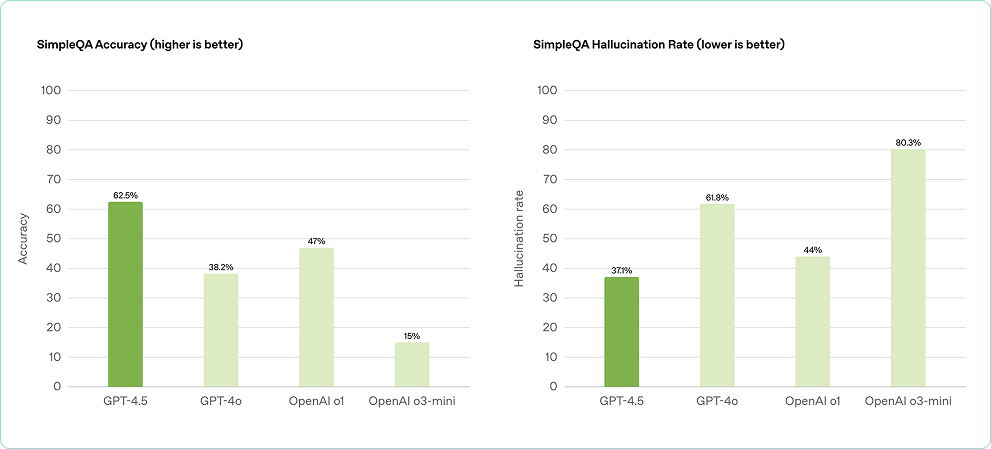

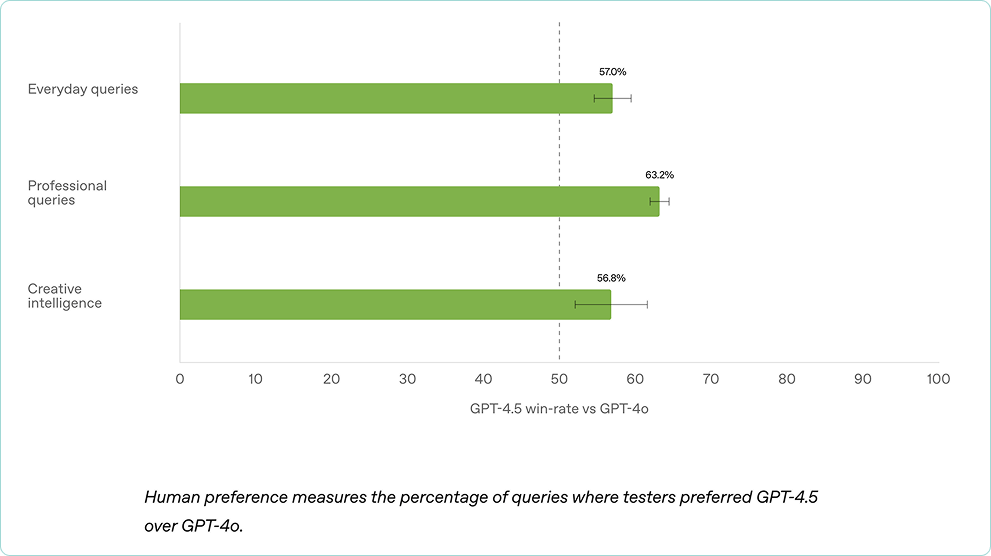

Darüber hinaus präsentiert Open AI Statistiken zu den Ergebnissen von Simple QA (das LLMs entsprechend ihrer Fähigkeiten zur Beantwortung herausfordernder Fragen testet) und Nutzerpräferenzen und vergleicht Chat GPT-4,5 mit früheren Versionen.

Quelle: https://openai.com/index/introducing-gpt-4-5

Schließlich durchlief GPT-4.5 den MMLU (Massive Multitask Language Understanding) LLM-Benchmark, der aus 16.000 Fragen aus 57 akademischen Fächern besteht und als Haupttester aller modernen LLMs fungiert. GPT-4.5 zeigte Ergebnisse von 92 % Genauigkeit in den Antworten in den 15 am häufigsten verwendeten Sprachen, darunter Englisch, Spanisch, Französisch, Chinesisch und Arabisch.

Trotz erfolgreicher Durchläufe der Ersttests und seiner vielversprechenden Ergebnisse zeigt ChatGPT eine wachsende Unzufriedenheit der Nutzer. Kunden berichten, dass die vorherige Version des Chatbots – ChatGPT 4o – an tiefgreifenden Denkfähigkeiten mangelt und ethische Fragen es daran hindern, einige spezifische Aufgaben zu lösen (zum Beispiel die Handlung eines Buches mit schlechtem Ende zu planen, da es immer versucht, die Geschichte auf eine gute Weise zu beenden). Darüber hinaus weisen einige Nutzer darauf hin, dass die Zeit der Anfrageverarbeitung und Antwortgenerierung auf eine so niedrige Rate reduziert wurde, dass die Nutzer den Ergebnissen einfach nicht vertrauen können.

Dennoch wird ChatGPT immer noch als gutes Werkzeug für Brainstorming und Ideengenerierung angesehen, was sich für Content-Ersteller und IT-Entwickler als nützlich erweist, während Open AI erklärt, dass die neueste GPT-4.5-Version alle vorherigen Nachteile beseitigt hat.

Die Implementierungsmöglichkeiten von ChatGPT bleiben erheblich, und das Modell kann über die OpenAI API in Ihre digitalen Produkte integriert werden. Wir erzählen mehr über bestimmte Vorteile und Überlegungen zur ChatGPT-API-Implementierung in unseren Artikeln über den Einfluss von ChatGPT auf die KI-Branche und die ChatGPT-Nutzung für Unternehmen.

Gemini 2.5

Der nächste explizite Vertreter der LLM-Branche ist Gemini und seine neueste Version Gemini 2.5, die am 25. März 2025 veröffentlicht wurde.

Die Gemini-Serie wurde 2023 als wettbewerbsfähige Antwort auf die Popularität von ChatGPT gestartet. In den vergangenen zwei Jahren wurden mehrere Versionen veröffentlicht, und Google erklärt, dass Gemini 2.5 das intelligenteste KI-Modell ist, das das Unternehmen je geschaffen hat.

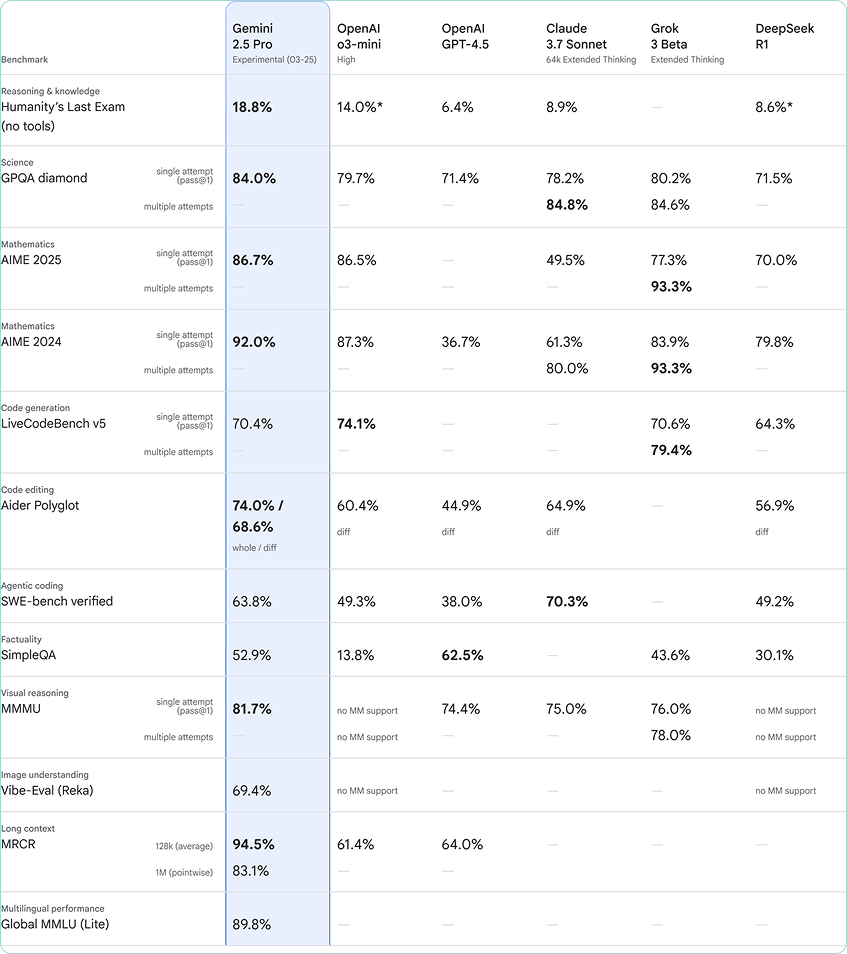

Das Modell hat bereits eine Vielzahl von Tests durchlaufen, die Dutzende von Leistungsmetriken enthalten, und Google demonstriert die Ergebnisse in einer umfassenden Tabelle und vergleicht sie mit anderen beliebten Modellen, einschließlich ChatGPT-4.5, Claude 3.7 und DeepSeek.

Die Marktberichte beweisen, dass Gemini in sehr kurzer Zeit ausreichende Ergebnisse erzielt hat (vor allem dank der großen Ressourcen, die Google für die KI-Entwicklung aufwenden kann). Der Hauptmarkt-Vorteil von Gemini 2.5 ist, dass das KI-Modell und alle seine Fähigkeiten für alle Nutzer ohne Abonnement verfügbar sind, während ChatGPT-4.5 ein Plus-Abonnement erfordert, um darauf zugreifen zu können.

Für diejenigen, die Gemini 2.5 in ihre Arbeitsabläufe oder Anwendungen integrieren möchten, ist eine spezielle Gemini API verfügbar. Allerdings ist das Modell zum Zeitpunkt Ende März 2025 noch experimentell, und Google warnt die Nutzer vor dieser Tatsache. Wir glauben, dass alle Einschränkungen in naher Zukunft behoben werden.

Claude 3.7 Sonnet

Das nächste Modell ist Claude 3.7 Sonnet, das von der Firma Anthropic am 24. Februar 2025 veröffentlicht wurde.

Das Modell verwendet ebenfalls ein Reasoning-Paradigma, aber auf einzigartige Weise, da die Reasoning-Fähigkeit je nach gewähltem Modus variiert.

Der Standardmodus ist eine verbesserte Version des vorherigen Claude-3.5-Modells, die wenig Zeit für die Anfrageverarbeitung benötigt. Der Extended-Thinking-Modus ist zeitaufwändiger (obwohl der Unterschied nur Sekunden beträgt), ist jedoch weitaus besser in Selbstreflexion und bei der Lösung von Aufgaben in Bezug auf Mathematik, Physik und Programmieren.

Darüber hinaus können diejenigen, die die Claude API nutzen, die Kosten des Denkens steuern. Da das Anthropic-Produkt 15 $ pro Million Output-Tokens berechnet, können Nutzer die Anzahl der für die Beantwortung der Anfrage benötigten Tokens anfordern. Das Ausgabelimit erreichte 128.000 Tokens (doppelt so viel wie Gemini 2.5), was Claude 3.7 perfekt für die Lösung von Aufgaben mit hohem Volumen macht.

Anthropic erklärt, dass sie den Fokus des Modelltrainings auf realistische Aufgaben verlagert haben, da sie versuchen, die Raten und Modelsituationen der realen Geschäftsnutzung zu erreichen. Fortschrittliche Reasoning- und Verarbeitungsfähigkeiten ermöglichen es Claude, ausreichende Ergebnisse in vielen Anwendungsfällen zu demonstrieren, wie zum Beispiel:

Programmieren. Es ist in der Lage, Aufgaben des gesamten Lebenszyklus zu erledigen – von der anfänglichen Planung und einfachen Codegenerierung bis zur Fehlerbehebung und Feinabstimmung.

Datenanalyse. Das Modell ist in der Lage, Daten aus visuellen Darstellungen wie Diagrammen oder Graphen zu extrahieren.

Content-Erstellung und -Analyse. Fortschrittliche Fähigkeiten des Kontext- und Semantikverständnisses ermöglichen es Claude, die tiefsten Ebenen der Inhaltsanalyse und Mustererfassung zu erreichen, daher bleibt das Schreiben einer der beliebtesten Anwendungsfälle.

Es ist bemerkenswert, dass Sie, wenn Sie bereits die Claude API in Ihren Produkten verwenden, keine Probleme mit Claude 3.7 Sonnet haben werden, da Anthropic allen seinen API-Nutzern Zugang gewährt hat.

DeepSeek V3

DeepSeek und seine neueste Version, DeepSeek V3, vorgestellt im Dezember 2024, ist das letzte in unserem Blogbeitrag betrachtete LLM, aber immer noch das kontroverseste.

Als das Modell erschien, sagte der globale Markt voraus, dass es der gefährlichste Konkurrent von ChatGPT sein würde. Die Vorhersage konzentriert sich hauptsächlich auf die Tatsache, dass die Entwicklungskosten von DeepSeek um eine Größenordnung niedriger sind als die Entwicklungskosten seiner Wettbewerber. Darüber hinaus ist der DeepSeek-Chatbot für jeden von überall und zu jeder Zeit verfügbar – es gibt keine geografischen, softwarebezogenen oder Abonnement-Einschränkungen bei seiner Nutzung.

Das DeepSeek-Team erklärt auch, dass das Modell mit 14,8 Billionen diversen und hochwertigen Tokens trainiert wurde, gefolgt von Phasen des supervised Fine-Tuning und Reinforcement Learning, um seine Fähigkeiten voll auszuschöpfen.

Obwohl es ein anständiges Werkzeug für Aufgaben in Bezug auf Zusammenfassung oder Themen-/Facherklärung ist, benötigt DeepSeek (insbesondere sein kostenloser Chatbot) noch weitere Verfeinerung. KI-Nutzer auf der ganzen Welt glauben, dass es noch ein langer Weg ist, aber jeder schätzt, dass ein Modell vom offenen Typ mit den Giganten des Marktes konkurrieren kann.

Bezüglich der Modellintegration in echte Anwendungen verwendet die DeepSeek API ein API-Format, das mit OpenAI kompatibel ist. Durch Änderung der Konfiguration können Nutzer auf das OpenAI SDK oder mit der OpenAI API kompatible Software zugreifen, um auf die DeepSeek API zuzugreifen.

LLM-Vergleich

Wie erwähnt, beabsichtigen wir nicht, ein benutzerdefiniertes LLM-Ranking zu erstellen und eine unbestreitbar genaue LLM-Rangliste zu liefern. Wir haben die Informationen überprüft, die von den oben genannten Modellentwicklern und von Spezialisten präsentiert wurden, die KI-Tools täglich in ihrer Arbeit und ihrem Hobby nutzen. Alle gesammelten Daten wurden in der folgenden Tabelle zusammengefasst:

| Kriterium | ChatGPT-4.5 | Gemini 2.5 | Claude 3.7 Sonnet | DeepSeek V3 |

|---|---|---|---|---|

| Benchmark-Leistung | - 92 % bei MMLU (57 Fächer) - Verbesserte Simple-QA-Werte | - #1 bei LMArena - 63,8 % bei SWE-Bench - 18,8 % bei Humanity's Last Exam | Stark bei Mathematik-/Physik-Benchmarks | Anständig, aber kein Benchmark-Führer |

| Sprachunterstützung | 15 Sprachen | Mehrsprachig (genaue Anzahl nicht spezifiziert) | Mehrsprachig (genaue Anzahl nicht spezifiziert) | Mehrsprachig (genaue Anzahl nicht spezifiziert) |

| Ausgabegröße (Tokens) | 128k Tokens | 65k Tokens | 128k Tokens | 128k Tokens |

| Preise/Zugang | Verfügbar für Plus-Nutzer | Kostenlos für alle Nutzer | Verfügbar über Claude-Pläne (Pro, Team, Enterprise) | Kostenlos für alle Nutzer |

| Beste Anwendungsfälle | - Brainstorming - Content-Erstellung - IT-Entwicklung | - Komplexes Reasoning - Programmieren - Mathematik-/Wissenschaftsaufgaben | - Programmieren - Datenvisualisierung - Inhaltsanalyse | - Zusammenfassung - Thematische Erklärung - Intelligente Empfehlungen |

| Schwächen | - Wahrgenommener Mangel an Tiefe - Ethische Einschränkungen - Geschwindigkeits- und Ausfallzeitenbedenken | Noch neu mit begrenzter realer Testung | Einschränkungen entsprechend dem gewählten Modus | - Benötigt Verfeinerung - Weniger ausgefeilt als Wettbewerber |

| Integrationsmöglichkeiten | Kann über die ChatGPT API integriert werden | Kann über die Gemini API erreicht werden, hat aber einige Einschränkungen, da das Modell noch experimentell ist | Verfügbar für alle Claude-API-Nutzer | Kann über das OpenAI SDK oder mit der OpenAI API kompatible Software erfolgen |

Fazit

Die rasante Evolution großer Sprachmodelle (LLMs) seit dem bahnbrechenden Debüt von ChatGPT im Jahr 2022 hat die KI-Landschaft verändert, wobei 2025 eine neue Ära des Wettbewerbs und der Spezialisierung markiert. Wie wir erforscht haben, bringt jedes der heutigen führenden KI-Modelle — ChatGPT-4.5, Gemini 2.5, Claude 3.7 Sonnet und DeepSeek V3 — einzigartige Stärken mit, die unterschiedliche Nutzerbedürfnisse erfüllen und neu definieren, was KI leisten kann. Dadurch ist kein objektiver und fairer KI-Vergleich möglich, ebenso wenig wie die Suche nach dem schnellsten, effizientesten und kosteneffektivsten Modell.

Was klar ist, ist, dass kein einzelnes LLM universell "das Beste" ist — die ideale Wahl hängt vom Kontext ab. Entwickler könnten Claude für lebenszyklusübergreifendes Programmieren bevorzugen, Forscher könnten sich auf Gemini für wissenschaftliche Strenge verlassen und Content-Ersteller mögen immer noch die Flüssigkeit von ChatGPT bevorzugen. Derweil beweist der Aufstieg von DeepSeek, dass Innovation außerhalb der Tech-Giganten gedeihen kann und auf eine vielfältigere Zukunft für KI hindeutet.

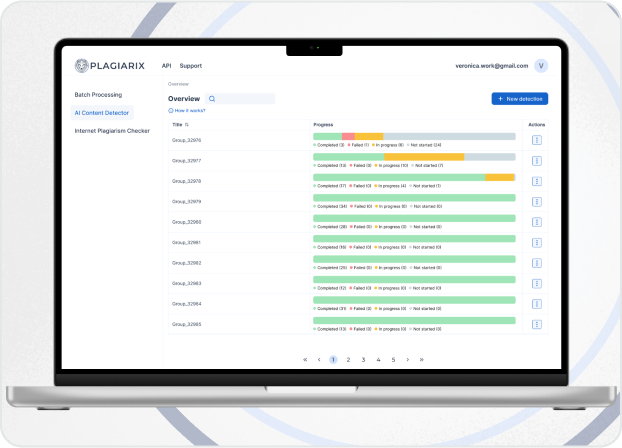

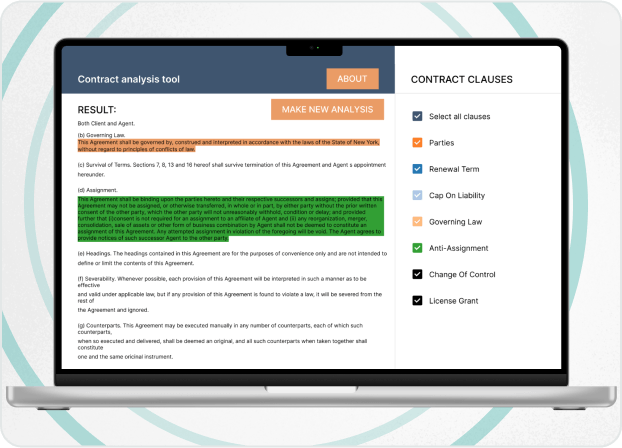

Unsere Lösungen

Wir arbeiten in verschiedenen Richtungen und bieten eine breite Palette von IT- und KI-Dienstleistungen an. Darüber hinaus können wir bei jeder Aufgabe Produkte unterschiedlicher Komplexität und Ausarbeitung bereitstellen, einschließlich Proof of Concept, Minimum Viable Product oder Full Product Development.