Gedanken des Autors

"ChatGPT hat sich schnell zu einem Giganten der globalen KI-Branche entwickelt und ist der beliebteste KI-Chatbot der Welt. Die Anwendungsmöglichkeiten sind atemberaubend, aber das Verständnis seiner Fähigkeiten erfordert die Berücksichtigung vieler Aspekte. Der folgende Blogbeitrag zeigt, wie ChatGPT Unternehmen nutzen kann und welche Aspekte bei der Implementierung zu berücksichtigen sind."

Yuri Svirid, PhD. — CEO Silk Data

Wie ChatGPT die KI-Landschaft verändert hat

Wenn wir über die KI-Branche sprechen, kommen wir unweigerlich auf das Thema ChatGPT und die Nutzung von ChatGPT für geschäftliche Zwecke zu sprechen. Dieser von OpenAI entwickelte KI-Chatbot hat die Branche revolutioniert und eine neue Ära in der Entwicklung Künstlicher Intelligenz und der Mensch-Maschine-Interaktion eingeläutet.

Einige Fakten über ChatGPT:

- 400 Millionen aktive Nutzer pro Woche bis Februar 2025 (im August 2024 waren es nur 200 Millionen).

- Über 2 Millionen Unternehmen aus 156 Ländern haben ChatGPT in ihre Workflows integriert.

- ChatGPT wird von 65% der Journalisten, Softwareentwickler und Marketingspezialisten in ihrer Arbeit genutzt.

In den letzten zwei Jahren wurde diese OpenAI-Lösung für Content-Erstellung und Übersetzung, Kundenbetreuung, Code-Schreiben und Debugging, Consulting und vieles mehr eingesetzt.

Angesichts seiner wachsenden Popularität, Benutzerfreundlichkeit und der breiten Palette an Aufgaben, die es lösen kann, ist ChatGPT zu einem Werkzeug geworden, das Unternehmen einsetzen möchten, um ihre Umsätze und Leistung zu steigern.

Silk Data präsentiert einen umfassenden Überblick über die Fähigkeiten von ChatGPT und die Perspektiven seiner Nutzung für Geschäftsziele.

Aufkommen von LLMs und ChatGPT 4o

Um die Natur der Popularität von ChatGPT und seinen Nutzen für Unternehmen zu verstehen, ist es notwendig, einen Blick auf die Large Language Models (zu denen ChatGPT gehört) zu werfen und die Frage "Was ist ChatGPT 4o?" zu beantworten.

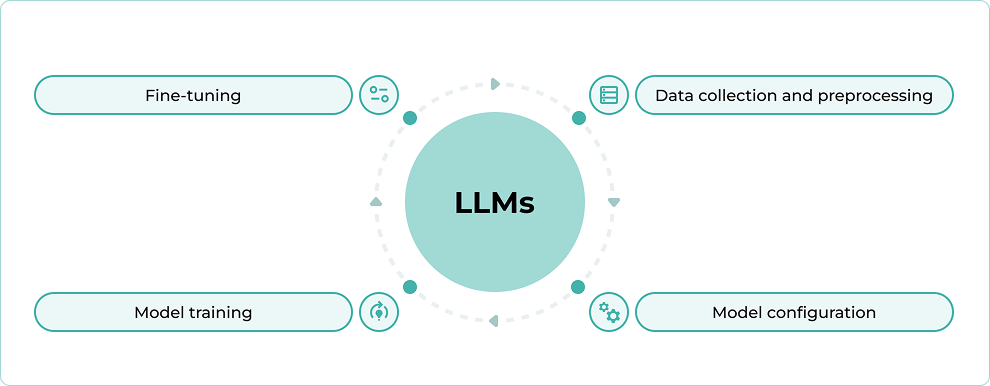

Grundlagen von Large Language Models

Large Language Models oder LLMs sind fortschrittliche KI-Systeme, die darauf trainiert sind, menschliche Sprache zu verarbeiten, zu verstehen und zu generieren. Die Geschichte der LLMs erstreckt sich über Jahrzehnte und beginnt mit primitiven Chatbots, die auf vordefinierten Vorlagenmustern basieren.

Traditionell werden komplexe LLMs auf riesigen Datenmengen trainiert (von Hunderten von Milliarden bis Billionen von Wörtern) und demonstrieren umfangreiche Fähigkeiten im kontextuellen Verständnis und der semantischen Analyse sowie eine hohe Genauigkeit der Antworten.

Dies wird durch mehrere grundlegende Merkmale erreicht, die die Funktionsprinzipien von LLMs definieren.

Beispielsweise ermöglicht die Transformer-Architektur, die aus einem Self-Attention-Mechanismus und Schichten besteht, dass das Modell sich auf die relevanten Teile der Texteingabe konzentriert und den Kontext des Textes versteht.

Der Trainingsprozess ist der wichtigste Teil der Modellentwicklung. Er beginnt mit dem Laden des Modells mit massiven Datensätzen (Bücher, Artikel, Websites usw.), die die Grundlage für das Verständnis von Wortsequenzen, Grammatik und Semantik der Sprache sowie für das Lernen von Fakten und Mustern zwischen ihnen bilden.

Das Modelltraining endet typischerweise mit dem Fine-Tuning, bei dem zusätzliche gelabelte Datensätze ausgewählt werden, damit das Modell spezifische Aufgaben lösen kann.

Moderne LLMs als Foundational Models

In den letzten zwei Jahren haben LLMs eine Reihe fortschrittlicher Fähigkeiten erlangt, wie z. B. das Bereitstellen von Antworten auf nicht nur textuelle, sondern auch visuelle und grafische Eingaben, Few-Shot- und Zero-Shot-Learning (wenn das Modell unbekannte Aufgaben basierend auf dem allgemeinen Sprachverständnis oder einigen Beispielen ausführen kann) und Reasoning-Funktionen.

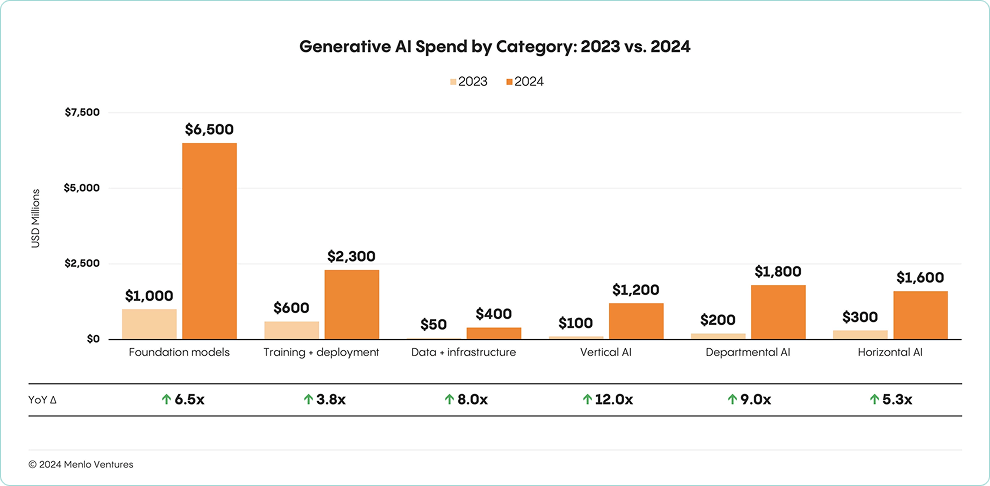

Darüber hinaus sind moderne LLMs zu Foundational Models geworden – eine Art von Modellen, die aufgrund des Trainings auf massiven Datensätzen für eine breite Palette von Anwendungsfällen eingesetzt werden können. Zusätzlich zeigte 2024 einen raschen Wandel im architektonischen Ansatz der LLM-Entwicklung. Die Bemühungen verlagern sich von der Datenvorbereitung/Dem Training hin zur Nutzung von API und RAG.

Quelle https://menlovc.com/2024-the-state-of-generative-ai-in-the-enterprise/

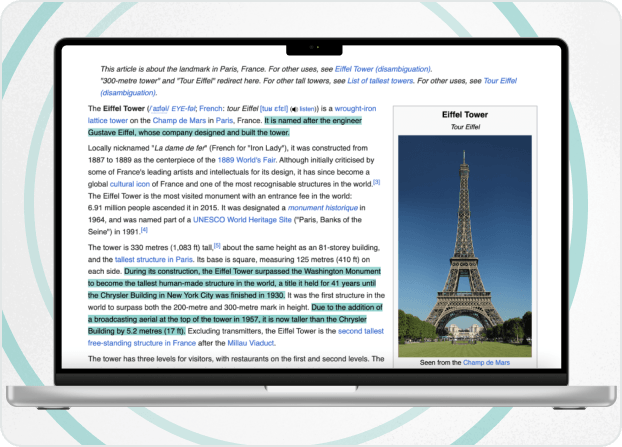

RAG oder Retrieval-Augmented Generation ist ein Framework, das die Generierungsfähigkeiten eines LLM durch den Abruf externen Wissens verstärkt.

Wenn beispielsweise ein Benutzer eine Anfrage stellt, arbeitet das LLM an deren Verarbeitung, während das RAG-Framework in einer externen Wissensdatenbank (Internet oder zusätzliche Quellen) nach den aktuellsten Informationen zur Eingabe sucht. Anschließend werden die Informationen als zusätzlicher Kontext an das LLM übergeben. Dadurch erhält der Nutzer die genaueste Antwort.

Die Verwendung des RAG-Ansatzes reduziert die Zeit, die Entwickler für das Fine-Tuning von Modellen aufwenden, drastisch (obwohl es sie nicht für alle Fälle vollständig eliminiert), da keine zusätzlichen Trainingsdatensätze erstellt werden müssen, die es dem LLM ermöglichen, spezifische Aufgaben zu lösen.

ChatGPT 4o

ChatGPT 4o ist eines der bekanntesten und berühmtesten Foundational Models. Im Mai 2024 vorgestellt, ist es die neueste Version der GPT-Large-Language-Models von OpenAI (obwohl das Unternehmen am 27. Februar 2025 eine Vorschau der GPT-4.5-Version veröffentlicht hat), wobei o für "omni" steht und einen Verweis auf die Multimodalität des Modells für Text, Vision und Audio darstellt.

Es handelt sich um ein Large Multimodal Model (LMM) oder ein Foundational Model, das auf Daten verschiedener Modalitäten (Texte, Video, Bilder) trainiert wurde und Echtzeitgespräche unterstützen sowie Texte, Bilder und Audio verarbeiten kann.

OpenAI liefert Informationen zu mehreren Aspekten, die die 4o-Version von ihren Vorgängern unterscheiden:

- Fähigkeit, jede Kombination aus Text, Audio, Bild und Video als Eingabe zu verarbeiten.

- Generierung von Text, Bild und Audio.

- Antwortzeit – ähnlich wie bei einem echten menschlichen Gespräch.

- Deutliche Verbesserung im Umgang mit nicht-englischen Sprachen (jetzt unterstützt es mehr als 50 Sprachen).

OpenAI erklärt, dass GPT 4o ein großer Schritt nach vorne in Richtung natürlicher Mensch-Computer-Interaktion ist.

Die Verwendung von ChatGPT oder anderen LLMs verlagert die Hauptkosten eines KI-Projekts vom Training und der Datenvorbereitung auf die Nutzung der API (oder das Bereitstellen des Modells).

ChatGPT für Unternehmen

Nachdem wir das Wesen von LLMs und insbesondere von ChatGPT betrachtet haben, ist es an der Zeit, einen Blick auf mögliche Anwendungsfälle von ChatGPT in verschiedenen Branchen zu werfen.

Marketing

Die Marketingbranche zeigt die höchsten Raten bei der Nutzung von ChatGPT-ähnlichen Produkten, wobei 45 % der weltweiten Marketingspezialisten KI in Marketingprozessen einsetzen. 71 % von ihnen verlassen sich auf ChatGPT.

Obwohl die beliebtesten Aufgaben Datenanalyse, Text- und Bildgenerierung und Content-Personalisierung sind, gibt es viele nicht-standardisierte Anwendungsfälle.

Beispielsweise verwendet Bing von Microsoft eine benutzerdefinierte Implementierung der GPT-4-Version, um seine Suchfunktionen zu verstärken.

Marketingspezialisten können die erweiterten Suchfunktionen von Bing nutzen, um die relevantesten Informationen zum Markt zu erhalten. In weiterer Perspektive können diese Suchergebnisse zusammengefasst werden, und ChatGPT kann spezifische Empfehlungen zur Marketingstrategie geben oder für die Überwachung von Wettbewerbern eingerichtet werden.

HR und Consulting

ChatGPT bietet erhebliche Vorteile für Personalwesen, Rekrutierung und Karriereberatung. Das Hauptziel ist die Optimierung des Prozesses der Kandidatenfilterung und -auswahl, die durch eine schnelle und effiziente Analyse ihrer Fähigkeiten und Berufserfahrung erreicht werden kann.

Wir haben eine solche Lösung entwickelt, die darauf abzielt, automatisiertes Lebenslauf-Screening durchzuführen. Mit ChatGPT-Implementierung im Kern wandelt das Tool unstrukturierte Lebensläufe in strukturierte Daten um, extrahiert und fasst relevante Informationen zusammen und vergleicht sie mit einer Stellenbeschreibung. Dadurch wurden die Zeit der Lebenslaufverarbeitung und die Einstellungskosten um 50 % gesenkt.

Für die Aufgabe der Karriereberatung kann eine ähnliche Lösung verwendet werden. Die ChatGPT-Implementierung kann helfen, relevante Informationen über die Karriere einer Person zu extrahieren und umfassende Empfehlungen zu neuen Rollen und Verantwortlichkeiten innerhalb des Unternehmens zu geben.

Kundensupport

Laut Statista werden etwa 57 % aller Aufgaben im Kundensupport mit ChatGPT durchgeführt.

Der Fokus liegt darauf, Kunden rund um die Uhr Verfügbarkeit und personalisierte Interaktion zu bieten.

Die Implementierung von ChatGPT optimiert auch die Workflows im Kundenservice. GPT-basierte Chatbots können schnell auf allgemeine Anfragen antworten, Bestellungen, Rückerstattungen und Rückgabeoperationen automatisch verfolgen oder mit der Unternehmenswissensdatenbank verbunden werden, um die für die Beantwortung benötigte Zeit zu reduzieren.

Hinweis! Trotz der fortschrittlichen Fähigkeiten von LLM-basierten Lösungen im Kundenservice zeigen aktuelle Umfragen eine weit verbreitete Ablehnung von Kunden, mit KI zu interagieren, während sie ihre Probleme lösen. Dies kann durch den Einsatz von KI-basierten Avataren gelöst werden, die dank fortgeschrittener Lern-, Imitations- und Stimmnachahmungsfähigkeiten menschenähnliche Interaktionen bieten können.

Bildung

Bildung ist eine weitere Branche, die stark von der Nutzung von KI-Tools und insbesondere ChatGPT profitiert. Eine Forbes-Umfrage besagt, dass etwa 60 % der Lehrkräfte im Jahr 2024 KI für den Unterricht eingesetzt haben, und die Zahl steigt.

Unterrichtsplanung, Zusammenfassung von Lernmaterialien und Empfehlungen – dies sind nur einige der Aufgaben, die KI-basierte Lösungen lösen können.

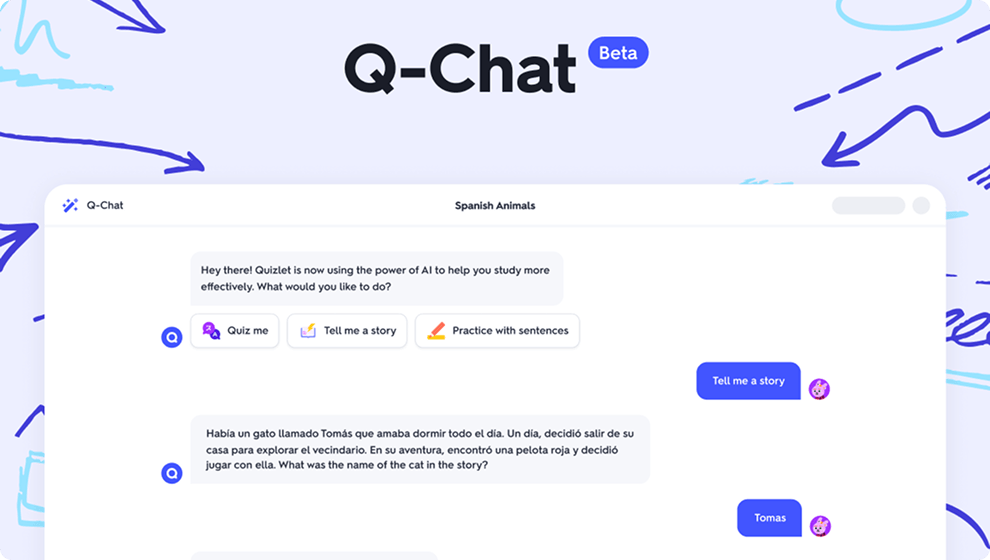

Einer der prominentesten Vertreter von LLM-basierten Tools ist Q-chat – der KI-Tutor von Quizlet, der auf einer Kombination aus ChatGPT-API und der umfangreichen Inhaltsbibliothek von Quizlet basiert.

Quelle https://quizlet.com/blog/meet-q-chat

Unter Verwendung der Fähigkeit des fortgeschrittenen aktiven Lernens kann Q-chat das Wissen der Schüler durch einen "Frage-Antwort"-Ansatz testen, umfassende Leitfäden zum Lernen von Themen oder Fächern bereitstellen und bestimmte Lerngewohnheiten empfehlen.

Hinweis! Wenn Sie mehr über ChatGPT und KI-Perspektiven für das Lernen erfahren möchten, werfen Sie einen Blick auf Silk Datas Blogbeitrag zum Thema KI-Trends in der Bildung.

Einzelhandel

ChatGPT und andere Foundational Large Language Models können für die Einzelhandelsbranche von Vorteil sein, indem sie Aufgaben der Einkaufsunterstützung und der Verfolgung von Kundenbindung und -zufriedenheit übernehmen.

Beispielsweise nutzen bekannte Marken wie H&M und Nike bereits LLM-basierte Chatbots, um Bestellungen zu verfolgen und personalisierte Einkaufsempfehlungen zu geben.

Amazon verwendet ebenfalls ein KI-basiertes Empfehlungssystem für Kunden. KI wird eingesetzt, um Produkte basierend auf dem Nutzerverhalten zu empfehlen, wie z. B. Browserverlauf, vergangene Käufe und Artikel im Warenkorb. Dadurch steigen die durchschnittlichen Bestellwerte und die Kundenzufriedenheit.

Hinweis! Weitere Informationen zu Perspektiven und Nutzen von ChatGPT und den Vorteilen seiner Anwendung in der Webentwicklung finden Sie in einem unserer Blogbeiträge.

Geschäftliche Vorteile von ChatGPT

Generative KI-Agenten haben sich als vielversprechendes Feld der KI erwiesen, da viele Unternehmen optimistisch sind, ChatGPT und seine Analoga im Geschäft einzusetzen. Dabei ist es notwendig, einen Überblick darüber zu geben, wie eine Kombination aus Künstlicher Intelligenz und intelligenten Agenten in der Praxis eingesetzt werden kann.

Automatisierung

Einer der Hauptvorteile von ChatGPT ist, dass es Routine- und zeitaufwändige Aufgaben automatisieren kann, wodurch die Zeit der Spezialisten und die Ressourcen der Unternehmen gespart werden, ohne dass die Produktivität sinkt.

Beispielsweise können ChatGPT-gestützte Tools 24/7-Service-Support bieten, Content-Vorlagen generieren, Daten extrahieren und riesige Dokumente zusammenfassen, wodurch Arbeitsstunden der Mitarbeiter gespart werden.

Workflow-Optimierung

ChatGPT ist auch gut darin, Arbeitsprozesse in verschiedenen Phasen in verschiedenen Geschäftsabteilungen zu optimieren.

Ein ChatGPT-basiertes Tool kann Aufgaben innerhalb eines Projekts priorisieren, Fristen setzen und Terminplanungsunterstützung leisten. Es kann die Arbeit mit Unternehmenswissen optimieren, indem es Dokumente und andere wichtige Daten organisiert, oder E-Mail-Entwürfe erstellen, um die Kommunikation zwischen Abteilungen zu beschleunigen.

Denken Sie über Workflow-Optimierung durch KI-Einsatz nach? Kontaktieren Sie uns und teilen Sie Ihre Anforderungen.

Breites Aufgabenspektrum

Die Fähigkeiten von ChatGPT im fortgeschrittenen Lernen und der Skalierbarkeit machen es bei der Bewältigung verschiedener Aufgaben hilfreich.

Kundensupport, Content- oder Code-Erstellung und kreative Ideengenerierung, Training, Consulting und personalisierte Empfehlungen – all diese Aufgaben können durch die Nutzung des OpenAI-Produkts gelöst werden (wenn es ordnungsgemäß implementiert, eingerichtet und feinabgestimmt ist).

Untersuchungen zur geschäftlichen Implementierung von ChatGPT demonstrieren die positive Wirkung des Chatbots.

Im Kundenservice wurde die Antwortzeit auf Kundenanfragen um 60 % reduziert, während die Personalbranche berichtet, dass die Dauer des Einstellungsprozesses um 50 % reduziert wurde. Die höheren Raten zeigen sich im Content- und Digital-Marketing, da ChatGPT den Prozess der SEO-optimierten Content-Generierung um das Fünffache beschleunigt.

ChatGPT-Integration vs. maßgeschneiderte LLM-Entwicklung

Aus geschäftlicher und entwicklungstechnischer Sicht hat die ChatGPT-Implementierung einen unbestreitbaren Vorteil – man kann eine Lösung oder eine Funktion eines Produkts sehr schnell liefern.

ChatGPT (und ähnliche Foundational LLMs) ist auf massiven Datensätzen trainiert, was es ihm ermöglicht, eine breite Palette von Aufgaben zu lösen. Diese Funktion entlastet Entwickler von der zeitaufwändigen Aufgabe des anfänglichen Sammelns und Labelns von Datensätzen. Im Wesentlichen kann der Modelltrainingsprozess auf die Erstellung eines kleinen Testdatensatzes reduziert werden, was die Kosten der Modellentwicklung drastisch senkt.

Die Abhängigkeit von einem bestimmten LLM-API-Anbieter macht das Produkt jedoch von diesem Anbieter abhängig. Latenz und Ausfälle, die die Schwachstelle von ChatGPT sind (der letzte bedeutende Vorfall geschah im Dezember 2024), können sich negativ auf die Produktivität der LLM-basierten Lösung des Unternehmens auswirken, während auch die Betriebskosten steigen.

Gleichzeitig kann die Inanspruchnahme der Option einer unabhängigen, aufgabenspezifischen LLM-Entwicklung in der Entwicklungsphase wesentlich zeitaufwändiger sein, aber eine solche vollständig angepasste Lösung verursacht in Zukunft weniger Probleme.

Überlegungen zur ChatGPT-Integration

Genauigkeit

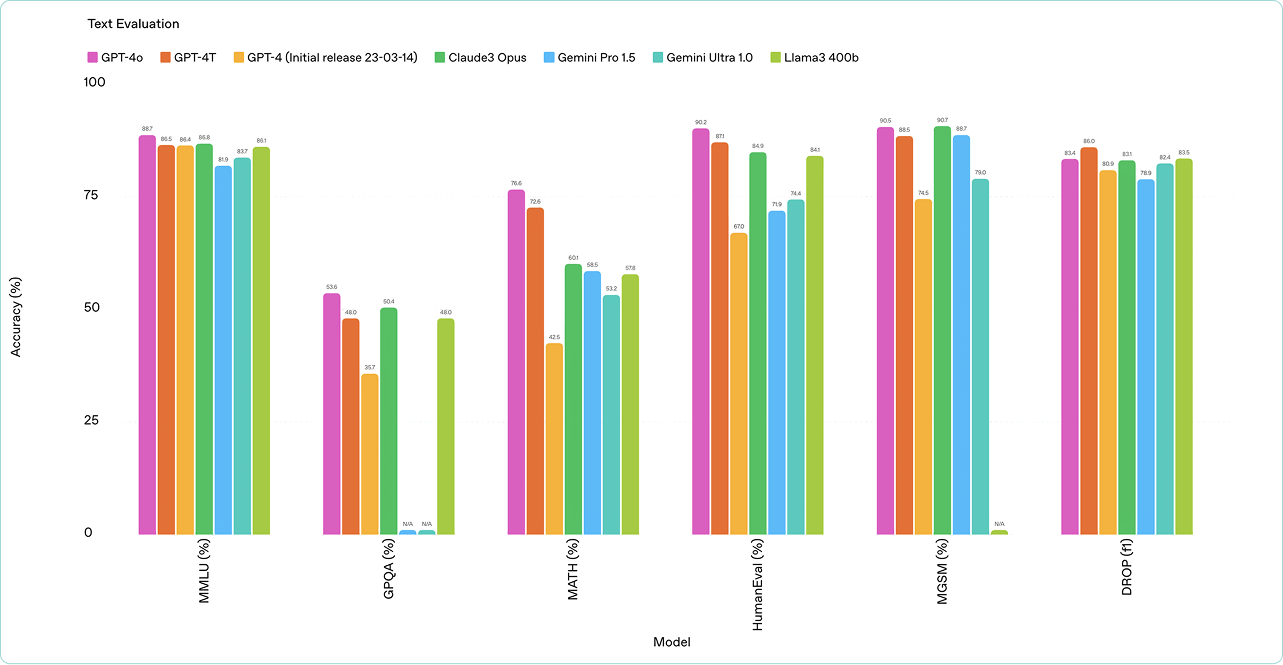

ChatGPT zeigt signifikante Fortschritte und ständige Verbesserungen in der Genauigkeit seiner Antworten.

OpenAI liefert eine umfassende Statistik der Fähigkeiten des neuesten GPT-4o-Modells bei der Lösung komplizierter Aufgaben und vergleicht es mit anderen Foundational LLMs, die von Google und Anthropic entwickelt wurden.

Quelle https://openai.com/index/hello-gpt-4o/

Die Realität zeigt jedoch, dass Unternehmen die Aufgabenerledigung noch nicht vollständig an eine Maschine delegieren können. Zusätzliche Überwachung und Überprüfung sind nach wie vor erforderlich, um ungenaue oder völlig falsche (=schädliche) Ergebnisse zu vermeiden.

Monopol

Während die ChatGPT-API leistungsstarke Vorteile bietet, die hauptsächlich mit der Kostenoptimierung der Modellentwicklung zusammenhängen, sollten Monopolrisiken berücksichtigt werden.

Wie bereits erwähnt, macht die Abhängigkeit vom OpenAI-Anbieter die Lösung von ihm abhängig. Unternehmen können aufgrund aktualisierter OpenAI-Betriebspreise, langer Latenzzeiten und Ausfallzeiten gezwungen sein, ihre Strategie zu überdenken. Darüber hinaus führt eine solche Abhängigkeit zu bestimmten ethischen und Sicherheitsbedenken hinsichtlich der Datenschutz- und Managementrichtlinie von OpenAI.

Eine der besten Lösungen, um diese Probleme zu vermeiden, ist der Einsatz von Open-Source-Modellen, zum Beispiel Llama, die eine gute Alternative zu ChatGPT mit mehr Freiheit darstellen.

Eines der Projekte von Silk Data basiert auf diesem Ansatz, da wir eine optimale Balance zwischen Kosten und Leistung fanden und uns entschieden, ein privates LLM-Modell auf einen Hetzner-Server zu migrieren. Als Ergebnis erhielt das Kundenunternehmen innerhalb eines Monats einen voll funktionsfähigen privaten LLM-basierten Chatbot.

Möchten Sie Ihr eigenes privates LLM starten? Lassen Sie uns die Details besprechen!

Regelmäßige Updates

Obwohl regelmäßige Updates der ChatGPT-API eine Reihe von Vorteilen bringen können, wie verbesserte Leistung oder Fehlerbehebungen, könnten sie auch mehrere Probleme verursachen.

Beispielsweise können unerwartete Änderungen zu Verschiebungen im Modellverhalten führen und Genauigkeit und Antwortzeiten beeinflussen. Gleichzeitig können Tools, die auf der ChatGPT-API basieren, zusätzliche Updates erfordern, um mit der neuen Version kompatibel zu bleiben. All diese Faktoren können zu zusätzlichen Kosten und Einbrüchen in der Modellproduktivität führen.

Datenschutz- und Sicherheitsfragen

Datenschutz- und Sicherheitsfragen bleiben kritisch bei der Nutzung einer beliebigen LLM-API. Unternehmen müssen potenzielle Risiken in Bezug auf sensible Daten und spezifische Vorschriften berücksichtigen.

In der praktischen Anwendung, wenn ein Benutzer eine Eingabe an ein ChatGPT-basiertes Tool sendet, wird der Inhalt der Eingabe an die OpenAI-Server übertragen, was beim Umgang mit sensiblen Daten gefährlich sein kann.

Gleichzeitig können Angriffe auf die Systeme von OpenAI auch ChatGPT-basierte Tools beeinträchtigen und Unternehmensdaten gefährden.

Richtige Risikominderungsstrategien können die Risiken auf ein Minimum reduzieren. Datenanonymisierung, Verschlüsselung und API-Zugriffskontrolle sind Möglichkeiten, Datenverletzungen und -lecks zu verhindern.

Schlussfolgerungen

ChatGPT hat die KI-Landschaft zweifellos revolutioniert und ist zu einem Flaggschiff moderner Geschäftsinnovation geworden. Seine Fähigkeit, Aufgaben zu automatisieren, Workflows zu optimieren und eine breite Palette von Funktionen zu bewältigen, hat es zu einem unverzichtbaren Werkzeug in verschiedenen Branchen gemacht, vom Marketing und Kundensupport bis hin zu Bildung und Einzelhandel.

Wie bei jeder leistungsstarken Technologie bringt die Integration von ChatGPT jedoch ihre eigenen Herausforderungen mit sich. Während das Modell erhebliche Vorteile bietet, kann die Abhängigkeit von einem einzelnen Anbieter wie OpenAI riskant sein, was Abhängigkeit von API-Verfügbarkeit, potenzielle Kostenerhöhungen und ethische Überlegungen zur Datennutzung sowie verschiedene Sicherheitsbedenken mit sich bringt.

Größere Anpassungsfähigkeit und Kontrolle erfordern die Verwendung eines hybriden Ansatzes, bei dem ChatGPT mit maßgeschneiderten Lösungen und offenen LLMs kombiniert wird, zusammen mit verschiedenen Risikominderungsstrategien.

Im Wesentlichen ist die beste Politik in Bezug auf die Nutzung einer beliebigen ChatGPT-ähnlichen Lösung im Geschäft, ein Gleichgewicht zwischen KI und menschlichen Anstrengungen zu finden und einzuhalten.

Unsere Lösungen

Wir arbeiten in verschiedenen Bereichen und bieten eine breite Palette von IT- und KI-Dienstleistungen. Darüber hinaus sind wir bei jeder Aufgabe in der Lage, Ihnen Produkte unterschiedlicher Komplexität und Ausarbeitung bereitzustellen, einschließlich Proof of Concept, Minimum Viable Product oder Full Product Development.