Lokales LLM-Deployment für eine Marketingagentur

Herausforderungen

In Anerkennung des transformativen Potenzials von KI suchte der Kunde nach einem selbst gehosteten KI-Chatbot, um den Workflow und die Zusammenarbeit seiner Marketing-Teams zu optimieren.

Die Hauptherausforderung bestand darin, einen Chatbot zu entwickeln, der mit einem persönlichen LLM (Large Language Model) ausgestattet ist und auf der internen Infrastruktur des Kunden gehostet werden kann. Die Lösung musste die Sicherheit interner Informationen priorisieren und sicherstellen, dass die Daten im privaten Netzwerk des Unternehmens blieben.

Nach erfolgreicher Zusammenarbeit bei der Entwicklung einer internen Marketing-Automatisierungsplattform war der Kunde gespannt, unsere bewährte Expertise erneut zu nutzen. Indem er sich auf Silk Data als KI-Entwicklungsunternehmen verließ, wandte sich der Kunde an unsere Experten, um ein LLM lokal auszuführen.

Über das Projekt

Unser Kunde, eine europäische Digital-Marketing-Agentur, unterstützt Unternehmen bei der Entwicklung von Content- und Kommunikationsstrategien in diversen Bereichen wie Fintech, IT und darüber hinaus.

Region

Europa

Zeitraum

Laufend

Team

6

Lösung

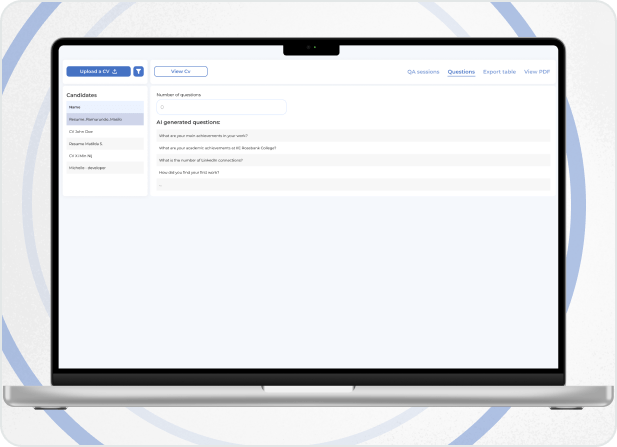

Um diese Herausforderungen anzugehen, stellte Silk Data ein spezielles Team von sechs KI-Experten zusammen.

Die anfängliche Entwicklungsphase für die Demoversion des LLM-Chatbots dauerte 22 Werktage. Das Team entschied sich für Mistral, ein Open-Source-LLM, als Grundlage für ihre Lösung.

Der erste Versuch, ein On-Premise-LLM auf einem Azure-Server laufen zu lassen, erwies sich als zu teuer für den Kunden, sodass eine kostengünstigere Lösung ohne Leistungseinbußen benötigt wurde. Nach der Analyse verschiedener Optionen entschied sich das Team, das private LLM-Modell auf einen Hetzner-Server zu migrieren, der ein optimales Gleichgewicht zwischen Kosten und Leistung bot. Dieser Setup ermöglichte es dem selbst gehosteten LLM, effizient mit einer Verteilung von 70 % auf GPU und 30 % auf CPU zu laufen, wodurch die Ausgaben erheblich gesenkt wurden, während die hohe Leistung erhalten blieb.

Wesentliche Entwicklungsphasen

LLM-Installation

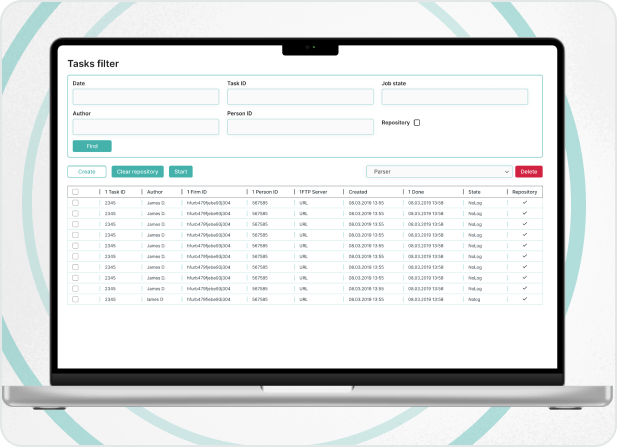

Das Team stellte das Mistral-LLM auf dem Hetzner-Server bereit und sicherte die Kompatibilität mit der gewählten Hardwarekonfiguration.Architekturentwicklung

Das Team erstellte die Benutzeroberfläche (Frontend) für den Chatbot und das Backend-System, das für die Kommunikation mit dem privaten LLM verantwortlich ist.LLM-Modelltest

KI-Ingenieure testeten das selbst gehostete LLM-Modell sorgfältig, indem sie ihm spezifische Kontexte gaben und seine Antworten bewerteten, um Genauigkeit und Relevanz sicherzustellen. Diese umfassenden Tests stellten sicher, dass der Chatbot grundlegende Konversationen fließend auf Deutsch und Englisch führen konnte.

Wesentliche Ergebnisse

Innerhalb nur eines Monats hat Silk Data erfolgreich die Demoversion eines KI-gestützten Chatbots entwickelt, trainiert, implementiert und getestet.

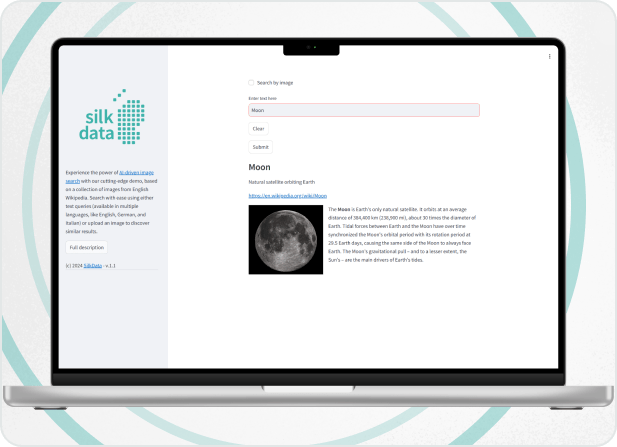

Silk Data stellte erfolgreich ein lokales LLM-Modell auf der internen Infrastruktur des Kunden bereit. Diese Lösung adressierte die Datensicherheitsbedenken des Kunden, indem sie sicherstellte, dass alle Informationen in ihrem privaten Netzwerk blieben. Erschließen Sie die Kraft der konversationalen KI! Bauen Sie Ihr eigenes LLM oder feintunen Sie ChatGPT für geschäftliche Anforderungen mit Silk Datas 10 Jahren KI-Expertise.

Warum ein LLM lokal ausführen?

Verbesserte Datensicherheit und Privatsphäre

Das Bereitstellen von LLMs in einer Private Cloud oder einem Unternehmensrechenzentrum stellt sicher, dass sensible Daten unter der Kontrolle der Organisation bleiben. Dies mindert Risiken im Zusammenhang mit Datenlecks, da die Daten nicht Drittanbieter-Cloud-Providern ausgesetzt sind. Die Einhaltung von Vorschriften wie DSGVO, HIPAA und CCPA ist einfacher zu handhaben, da Organisationen ihre strengen Sicherheitsmaßnahmen implementieren und überwachen können.

Anpassung und Kontrolle

Organisationen haben volle Kontrolle über die Konfiguration des Modells, was umfangreiche Anpassungen ermöglicht. Dazu gehört die Anpassung des LLM an spezifische Branchenjargon, interne Richtlinien und einzigartige Geschäftsprozesse, was die Relevanz und Genauigkeit der Modellantworten erheblich verbessern kann.

Reduzierte Latenz und erhöhte Leistung

Das Hosten eines LLM auf lokaler Infrastruktur kann die Latenz verringern und schnellere Antwortzeiten im Vergleich zu entfernten Cloud-Diensten bieten. Dies ist entscheidend für Echtzeitanwendungen wie KI-Chatbots für Kundensupport, bei denen schnelle Antworten wesentlich sind.

Kostenmanagement

Obwohl die anfänglichen Hardwarekosten hoch sein mögen, kann das Ausführen von LLMs On-Premises oder in einer Private Cloud auf lange Sicht kostengünstiger sein als die Bezahlung für umfangreiche Nutzung von Drittanbieter-Cloud-Diensten.

Lokales LLM-Deployment: Fallstricke

- Inkompatibilität mehrerer LLM-Modelle

Bei der Integration mehrerer Modelle treten häufig Inkompatibilitätsprobleme aufgrund von Unterschieden in der Architektur, Datenformaten und Betriebsanforderungen auf. Jedes Modell kann mit unterschiedlichen Frameworks, Annahmen und Abhängigkeiten entwickelt worden sein, was zu Herausforderungen bei der nahtlosen Integration führt.

- Skalierbarkeitsherausforderungen

Während Private Clouds und lokale Rechenzentren Kontrolle und Sicherheit bieten, kann die Skalierung der Infrastruktur, um den ständig wachsenden Rechenbedarf von LLMs zu decken, herausfordernd sein. Anders als öffentliche Cloud-Dienste, die Ressourcen dynamisch basierend auf der Nachfrage zuweisen können, können private Infrastrukturen bei der schnellen und effizienten Skalierung, insbesondere während Spitzenzeiten der LLM-Installation, an Grenzen stoßen.

- Reduzierte Genauigkeit des LLM-Modells

Große Modelle sind typischerweise dafür konzipiert, umfangreiche Rechenressourcen und verteilte Rechenumgebungen zu nutzen. Wenn diese Modelle für lokale Hardware angepasst werden, müssen Kompromisse eingegangen werden, um das Modell in den verfügbaren Speicher- und Verarbeitungsbeschränkungen unterzubringen. Techniken wie Modellquantisierung können die Modellgröße reduzieren und die Effizienz verbessern, gehen aber oft auf Kosten reduzierter Genauigkeit und Verallgemeinerungsfähigkeit. Die Komplexität der ursprünglichen Modellarchitektur lässt sich möglicherweise nicht vollständig auf eine verkleinerte Version übertragen, was zu verminderter Leistung führt. Die Balance zwischen Modelleffizienz und Leistung ist eine kritische und kontinuierliche Herausforderung beim lokalen Betrieb von LLMs.

- Sicherheitsrisiken

Trotz der erhöhten Kontrolle sind private Umgebungen nicht immun gegen Sicherheitsrisiken. Interne Bedrohungen wie böswillige Insider oder unzureichende Sicherheitspraktiken können erhebliche Risiken darstellen. Zudem erfordert der Schutz der Infrastruktur gegen externe Bedrohungen robuste Sicherheitsmaßnahmen, kontinuierliche Überwachung und regelmäßige Updates.

Häufig gestellte Fragen

Lassen Sie uns diese Konzepte aufschlüsseln: NLP (Natural Language Processing) ist ein Bereich der KI, der sich darauf konzentriert, Computern zu ermöglichen, menschliche Sprache zu verstehen, zu interpretieren und zu generieren. LLMs (Large Language Models) sind fortschrittliche KI-Modelle, die auf riesigen Textdatenmengen trainiert wurden, um verschiedene sprachbezogene Aufgaben auszuführen. GPT (Generative Pre-trained Transformer) ist eine spezifische Art von LLM, die von OpenAI entwickelt wurde und für ihre Fähigkeit bekannt ist, kohärenten und kontextuell relevanten Text basierend auf Eingabeaufforderungen zu generieren. Im Wesentlichen ist NLP das breitere Feld, während LLM und GPT spezifische Implementierungen innerhalb dieses Feldes sind.

Der Aufbau eigener LLMs ist vor allem wegen der massiven Rechenressourcen teuer, die für das Training an riesigen Datenmengen und die Feinabstimmung für spezifische Aufgaben erforderlich sind. Das Training dieser Modelle beinhaltet das Ausführen komplexer Algorithmen über Millionen oder sogar Milliarden von Textbeispielen, was umfangreiche Rechenleistung, einschließlich hochwertiger GPUs, erfordert. Zudem tragen die Kosten für die Speicherung und den Zugriff auf die enormen Datensätze, die für das Training verwendet werden, zu den Gesamtkosten bei. Darüber hinaus erhöhen die benötigte Expertise und Arbeitskraft für die Entwicklung und Feinabstimmung dieser Modelle deren Kosten weiter. All diese Faktoren zusammen machen LLMs zu einer erheblichen Investition für Unternehmen und Organisationen.

Ja, es ist möglich, ein LLM mit Ihren eigenen Daten zu trainieren. Seien Sie jedoch auf eine herausfordernde Reise vorbereitet. Das Training privater LLMs erfordert Expertise im maschinellen Lernen, Zugang zu erheblichen Rechenressourcen (leistungsstarke Computer) und große Datensätze. Das Training kann Tage, Wochen oder sogar länger dauern, abhängig von Modellgröße und -komplexität. Ihr selbstgemachtes LLM könnte nicht so gut abschneiden wie modernste Modelle, die von großen Unternehmen an massiven Datensätzen trainiert wurden. Daher ist ein alternativer Ansatz, der in Betracht gezogen werden sollte, das "Feintuning" eines bereits existierenden Modells, um es an Ihre spezifischen Anforderungen anzupassen. Diese Methode ist oft einfacher und kann effektive Ergebnisse liefern.